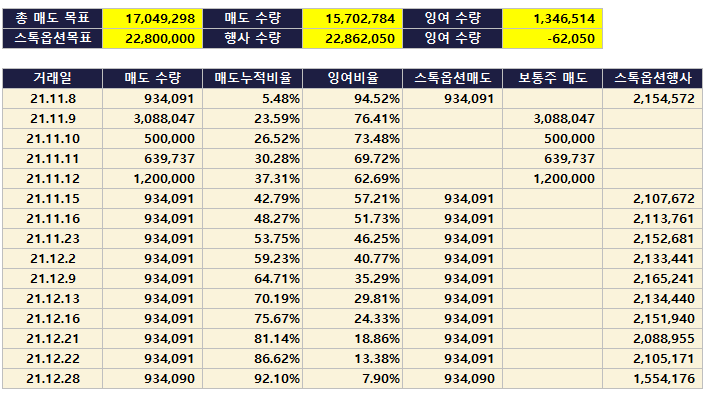

어제 마지막으로 934,090주를 팔아 스톡옵션 2,280만주를 모두 행사하여 15,702,784주를 매도했다. 이에 따라 엘론마스크는 7천159천266주가 늘어나 약 한 달 동안 주주가 고점 대비 20~30% 낮은 가격으로 매수할 수 있는 여건을 조성했다. 당연히 일론이 가장 큰 돈을 버는 일이지만 MDD 2030%가 형성되는 것은 장기투자자에게 바람직한 현상이다.

4분기 인도량 발표와 함께 2021년 인도량도 곧 발표되겠지만 반복적으로 매도된 934,091이 인도량 숫자에 육박할 가능성이 높다. 처음 거듭 매도당할 때부터 예상했던 일이지만 실제로 그렇게 설계됐다면 어처구니가 없을 것이다.

그와 동시에 AI 과학자 Lex Fridman의 유튜브 방송에도 출연했다. 이 영상은 번역영상도 올릴 생각이다. 파트별로 내용을 적어볼 생각이야.

외국의 유튜버 중 Lex Fridman이라는 사람은 꽤 믿을 만한 사람 중 한 명이다. 그는 MIT에서 자율주행차, 인간과 로봇의 상호작용, 머신러닝에 대해 연구하는 사람이다. 여러 사람을 인터뷰하지만 질문과 대화의 내용이 꽤 깊다. 과거의 짐 켈러에 대한 영상도 그렇고, 이번 엘론 마스크라는 영상도 하나도 빼놓지 않고 듣고 정리해야 한다.

이 영상에 대한 내용은 Space X와 Starship, 포기하지 않는 일론의 마인드와 사고하는 과정, 화성플랜, 웜홀, 스마트 콘트랙트, 도지코인, 비트코인, 사토시나카모토, 테슬라의 오토파일럿과 FSD, 뉴링크, 자율주행 완성시기 예상, FSDV11, 테슬라봇, 역사, 젊은이를 위한 조언, 인생에 대한 생각 등 거의 모든 것을 경험한다.

인터뷰: Autopilot, Self-Driving LexFridman 유튜브*의 질문과 답변을 섞어서 정리했습니다.

테슬라 오토 파일럿은, 지난 6년간, 관계가 있는 많은 사람들의 마음속에서 놀라운 여행을 했습니다. 처음에는 오토 파일럿의 자율성을 정말 좋아했고, 모든 여정이 너무나 놀라웠습니다. MITAI 과학자들은 컴퓨터 비전에 대한 어려움을 알고 있으며 MIT가 출전한 Darpa Robotics Challenge에서 본 이 기술의 여정은 훌륭했습니다.

처음 테슬라를 운전한 사람들은 초기의 새로운 시스템에 대한 자연스러운 회의감을 갖고 있었습니다. 초기에는 차가 차선에 머물러 편안한 경험을 줄 수 없다고 생각했습니다. 처음에는 차선 유지조차 어려울 줄 알았는데 비교적 쉬웠어요. 프로토타입과 모빌아이(물건을 구분하는 로봇, 컴퓨터와 접속하고 눈앞에 있는 것을 구분함) 주위에 수백만 가지의 코드를 생성하는 즐거운 경험을 통해 해결할 수 있었습니다.

여기서 중요했던 테슬라의 결정은 하드웨어와 소프트웨어를 처음부터 다시 시작하는 것이었어요. 매우 어려운 일이어서 해결할 수 있을까 회의적이었지만 센서를 계산할 수 있는 하드웨어와 앙드레 카파시가 이끄는 데이터 셋의 선택이 가장 중요했습니다. (딥러닝이 로켓의 엔진이라면 데이터는 엔진에 투입되는 연료이기 때문에 딥러닝이 의미 있는 결과를 보여주기 위해서는 라벨링되어 있는 데이터 셋이 있어야 하기 때문.)

모든 데이터 엔진과 신경 네트워크 아키텍처를 실제 환경에서 테스트하는 방식으로 처리합니다. 이미지와 비교하여 네트워크가 검증하는 방식입니다. 컴퓨터 비전 모델은 실제 인공지능과 동일합니다.

앙드레는 정말 멋지고 중요한 역할을 하지만 재능있는 사람들이 너무 많아요. 아쇼크는 오토 파일럿 엔지니어링의 책임자이고, 앙드레는 AI의 총책임자입니다. 엘론 머스크 뿐만 아니라 앙드레의 평가도 상당히 높습니다.

테슬라의 오토 파일럿과 AI 팀은 세계에서 가장 영리한 사람들이에요. 지난 5년 동안 오토 파일럿을 통해 몇 가지 자율주행에 대해 통찰할 수 있었습니다. 이 문제를 생각보다 훨씬 어려웠어요. 자동운전을 해결합니다. 기본적으로 인간은 센서인 눈과 생물학적 신경망을 통해 운전합니다.

그래서 오토 파일럿 시스템이 눈이나 신경망처럼 기능할 수 있도록 설계되어 있습니다. 그리고 이것은 실제 운전을 위해서 디지털 형식으로 재현하지 않으면 안 됩니다. 그래서 진보된 형태의 신경망을 가진 카메라를 사용합니다. 완전한 자율주행을 위해서 이 문제가 해결될 겁니다. 지금 방법을 생각할 수 있는 유일한 방법은 아니지만 인간의 본성에 맞게 인코딩을 해야 합니다.

먼저감지와같은인식문제를해결해야합니다. 인식은 통제와 계획이 결합되어 있어 다양한 엣지 케이스에서 운전에 관한 것이 무엇인지 파악해야 하고, 게임이론에 나오는 네 방향의 정지 표시 같은 것이 얼마나 많이 관여하고 있는지, 행동하는 것이 세상에 어떤 영향을 미치는지에 대한 문제를 해결해야 합니다.

테슬라는 정확한 벡터 공간을 만들고 있습니다 (거대한 이미지 공간의 비트스트림과 같은). 정확한 벡터 공간을 갖는 것은 매우 어렵습니다. 인간의 뇌는 주위를 둘러볼 때 놀랄 만큼 많은 정보를 처리하여 깔끔한 이미지를 보여줍니다. 사각지대는 뇌가 스스로 채우고 막대한 양을 후처리합니다. 뇌는 모든 정보를 얻더라도 많은 것을 잊기 위해 끊임없이 노력합니다. 인간의 기억은 너무 한정되어 있기 때문에 가능한 한 많은 것을 잊으려고 합니다.

뇌는 가능한 한 작은 정보에만 도달하도록 노력합니다. 기억은 인간의 뇌에서 가장 약한 부분입니다. 인간은끊임없이주의를산만하게하고생각하며문자를보내고,라디오를듣고차안에서하지말아야할일들을다합니다. 카메라랑 달라요

운전 중 우리는 주위의 모든 방향에 대한 벡터 공간을 고치기 위해 주위를 둘러보며 운전에 필요한 최소한의 정보의 양만큼 뇌를 편집합니다. 그것은 더 이상 공간적으로 표현되지 않습니다. 그리고 벡터 공간이 확립된 후에 예측을 해야 합니다. 사람이 길을 건널 때 버스나 트럭이 시야를 막고 있으면 바로 건너간다는 것이 보이지 않아도 예측할 수 있게 되어 있어야 합니다. 그렇기 때문에 시야가 가려져도 사람이 있었다는 것을 잊지 말고 위치 변화도 예측해야 됩니다.

인간은 시간이 흐른다는 개념을 알고 있어서 꼭 기억해야 하는 게 있습니다. 이전에는 그물을 너무 쳐서 문제가 많았고, 이렇게 층이 너무 많아도 문제가 됩니다. 완전히 자동 주행하기 위한 계산을 많이 하기 위해 한정된 컴퓨팅 중 가장 높은 초당 프레임을 가지려고 노력하고 있습니다.

대부분의 카메라는 사진을 깨끗하게 하기 위해 많은 뒷처리를 하지만, 우리는 이미지를 뒷처리하지 않는 것이 우리의 방향입니다. 우리는 단지 많은 데이터를 원하고 있습니다. 컴퓨터가 보는 이미지가 필요해요. 이 이미지에는 카메라에 표현된 것보다 훨씬 많은 데이터를 가지고 있습니다.

그렇다는 것은 어두운 곳에서도 잘 볼 수 있다는 것입니다. 미세한 차이를 여러분이 상상하는 것보다 훨씬 더 잘 알 수 있어서 대기시간을 절약할 수 있습니다. 뒷처리를 제거하면 지연시간이 없어집니다. 카메라에서 컴퓨터로 거치는 동안 다양한 시간의 공차가 있어요. 작은 시간에 무슨 일이 일어날지 모르기 때문에 낮은 지터(jitter, 시간 왜곡, 흐트러짐 등)는 자동차의 초인적인 능력과 반응 시간으로 남보다 빠르게 움직이게 됩니다.

시간이 흐를수록 자율주행은 제임스 본드보다 더 많은 것을 합니다. 지난 6년을 돌이켜보면 테슬라는 자율주행 레벨 4단계를 해결할 가능성이 높다. 백만 마일 당 운전자의 개입 시간은 극적으로 떨어지고 있으며, 추세는 내년(2022년)에나 일어날 것입니다. FSD의 사고율은 인간보다 훨씬 낮습니다. 내년에는 확실히 도달할 겁니다. 사람보다 2~3배 정도 뛰어납니다.

Rex Fridman YouTube